Appena il tempo di insediarsi alla Casa Bianca e il presidente degli Stati Uniti Donald Trump ha annunciato il progetto Stargate, un piano da 500 miliardi di dollari per potenziare l’infrastruttura a sostegno dell’Intelligenza Artificiale “made in the USA”. Una vera e propria nuova “corsa allo spazio” che questa volta vede contrapporsi agli Stati Uniti non più l’Unione Sovietica ma la Cina. Una contrapposizione tecnologica evidenziata dalla notizia che il chatbot basato su intelligenza AI dell’azienda cinese DeepSeek ha superato l’americana ChatGPT, diventando l’applicazione gratuita più scaricata sull’App Store negli Stati Uniti. Un fatto che ha avuto delle ripercussioni anche negli andamenti borsistici con fluttuazioni rilevanti per i titoli tecnologici. Insomma, l’Intelligenza Artificiale si prefigura destinata a cambiare gli assetti tecno-industriali e la nostra vita quotidiana. I primi effetti si riscontrano anche in Italia. Risale a qualche giorno fa, infatti, l’annullamento per 362 studenti di una prova d’esame all’Università di Ferrara (Ateneo dove peraltro lavora il sottoscritto) poiché “è emerso che numerosi partecipanti hanno fatto uso di strumenti esterni, come ChatGPT e altre applicazioni online, per rispondere alle domande”. Questa la motivazione dei docenti. Sin dal novembre 2022, quando OpenAI rilasciò la versione gratuita di ChatGPT, l’Intelligenza Artificiale generativa è prepotentemente entrata nelle aule universitarie e nelle scuole, e ha prodotto un amplissimo dibattito su aspetti etici, economici, giuridici e politici a livello sia nazionale sia internazionale [4 -5]. Per superare la dicotomia che spesso contrappone i “tecnoentusiasti” ai “tecnosciettici”, e offrire così una riflessione basata su dati e statistiche, da due anni il centro di ricerca Observa Science in Society ha iniziato a indagare le percezioni, le aspettative e le preoccupazioni dei cittadini italiani rispetto all’Intelligenza Artificiale [1].

Come per il 2023, anche nell’ultimo anno il 14% dei cittadini pensa che i sistemi in grado di produrre autonomamente testi vadano incoraggiati perché rappresentano un’ottima opportunità nell’ambito lavorativo ed educativo; il 16% ritiene, invece, che chatbot come ChatGPT vadano proibiti in quanto rappresentano una minaccia per l’occupazione e la responsabilità umana. Cresce invece la quota di coloro che ritengono che questi strumenti tecnologici possano essere utilizzati ma vadano rigidamente regolamentati. Nel 2023 era il 54% dei cittadini a pensarla in questo modo, mentre nel 2024 la quota è salita al 69%. Una maggiore familiarità con gli strumenti di IA generativa, sempre più utilizzati, sembrano aver concorso a promuovere un atteggiamento di crescente cautela e un’ampia richiesta di regolamentazione, in linea con l’AI Act, il primo provvedimento normativo adottato dall’Unione Europea nel maggio 2024.

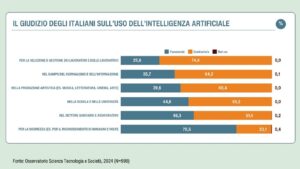

Ma in quali settori, i cittadini italiani sarebbero dunque più favorevoli a un utilizzo dell’Intelligenza Artificiale? Come molte indagini hanno evidenziato da tempo, la sicurezza è un tema particolarmente rilevante per l’opinione pubblica. Non sorprende quindi che i cittadini italiani vedono favorevolmente l’impiego dell’Intelligenza Artificiale in questo settore (per esempio, attraverso l’uso di sistemi di riconoscimento facciale, già particolarmente diffusi in alcuni Paesi). Meno di un cittadino su cinque si dice contrario all’applicazione dell’IA per la sicurezza. Poco più di un cittadino su due si dichiara contrario all’impiego dell’IA nel settore bancario e assicurativo o nella scuola e nelle università. Un’ampia contrarietà dell’opinione pubblica si riscontra invece nell’eventuale impiego di sistemi di Intelligenza Artificiale nel campo della produzione artistica (per es. musica, letteratura, arte), nel settore del giornalismo e dell’informazione e per la selezione e gestione dei lavoratori e delle lavoratrici. In questo caso, solo il 25% si dice favorevole.

Un altro dato che emerge in modo chiaro dall’indagine condotta da Observa è la richiesta di informazione. Gli italiani si definiscono poco informati sull’intelligenza artificiale: più di sei su dieci affermano di essere poco o per niente informati, mentre solo un cittadino su tre a dirsi abbastanza o molto informato. La percezione del proprio livello informativo varia sulla base di alcune caratteristiche sociodemografiche: il livello di disinformazione è più elevato tra i più anziani e tra coloro che possiedono un livello di istruzione più basso. Si tratta di un dato interessante soprattutto alla luce dell’ampia copertura mediatica che il tema dell’intelligenza artificiale ha ricevuto dal rilascio di ChatGpt.

L’indagine promossa da Observa è stata recentemente pubblicata sul magazine Scienza, Tecnologia e Società, consultabile sul sito del centro di ricerca [2]. Il rapporto presenta altri dati interessanti, dalle fonti d’informazione alle opinioni sul futuro rapporto tra AI e società, dall’immaginario all’uso quotidiano di dispositivi basati sull’IA. Raccontarli tutti adeguatamente ci impegnerebbe ben oltre “il tempo di un caffè”. In attesa di sorseggiare insieme la prossima tazzina, vale la pena soffermarsi su una indicazione che emerge in modo particolare: secondo i cittadini italiani le innovazioni come ChatGpt non vanno ostracizzate, bensì è necessario esercitare una forte governance pubblica. Non vietare la tecnologia dunque, ma governare l’innovazione. È quello che sostengono i cittadini italiani. Le tecnologie basate sull’intelligenza artificiale generativa hanno aperto un confronto sulle finalità dell’IA e sulle possibili conseguenze nelle relazioni sociali e professionali di queste innovazioni. L’Intelligenza Artificiale non è stata accolta dall’opinione pubblica con un atteggiamento di diffidenza, ma nell’ultimo anno appare maturata una crescente consapevolezza dei rischi e delle opportunità insite nel processo di innovazione tecnologica. Vanno interpretati in questa prospettiva i dati sin qui presentati. In conclusione, da parte degli italiani c’è l’aspettativa di una maggiore informazione e di una regolamentazione chiara e trasparente che non ostacoli l’innovazione ma la renda più sicura e fruibile.

Andrea Rubin

Per approfondire

- [1] Rubin, A. (2024), Come viene percepita l’IA dagli italiani?, in «Il Mulino», 23 aprile 2024.

- [2] Rubin, A. e Bucchi, M. (2025), L’Intelligenza Artificiale. Percezioni, aspettative, preoccupazioni, in «Scienza Tecnologia e Società», I, pp. 15-17.

- [3] Bucchi, M. e Rubin, A. (2025), Quanto ci fidiamo degli scienziati? Parecchio (se non vanno in tv), in «Corriere del Veneto – Corriere Imprese», 10 febbraio 2025.

- [4] Ciofalo, G., Pedroni, M., & Setiffi, F. (2024). Università italiana, docenti e ChatGPT. La zona grigia tra pratiche lavorative e immaginari, in «Cambio», 14, 27, pp. 97-107

- [5] Bates, T. et al. (2020), Can Artificial Intelligence Transform Higher Education?, in «International Journal of Educational Technology in Higher Education», 17(1).